③ AIの仕組み

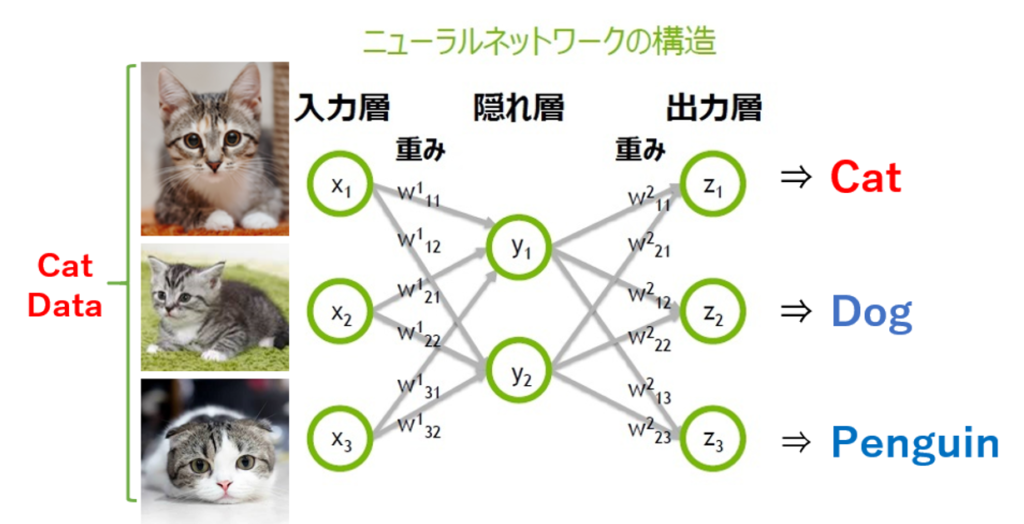

Deeplearningとは、脳内の神経細胞(ニューロン)を模したNeural Networkを何段階もの深い層に重ね、入力されたデータから特徴量(パターン)を抽出する手法である。特に近年、画像分野で注目されているのはCNN(Convolution Neural Network)と呼ばれるものである。

大量の手本となるデータを入力し、欲しい出力結果を指定する。何層もの階層の中から数学的に近い関数を導き出すことで、真値(求めたい値や結果)に近づけようとする手法である。iPhoneのカメラも画質向上のために、同手法を用いている。

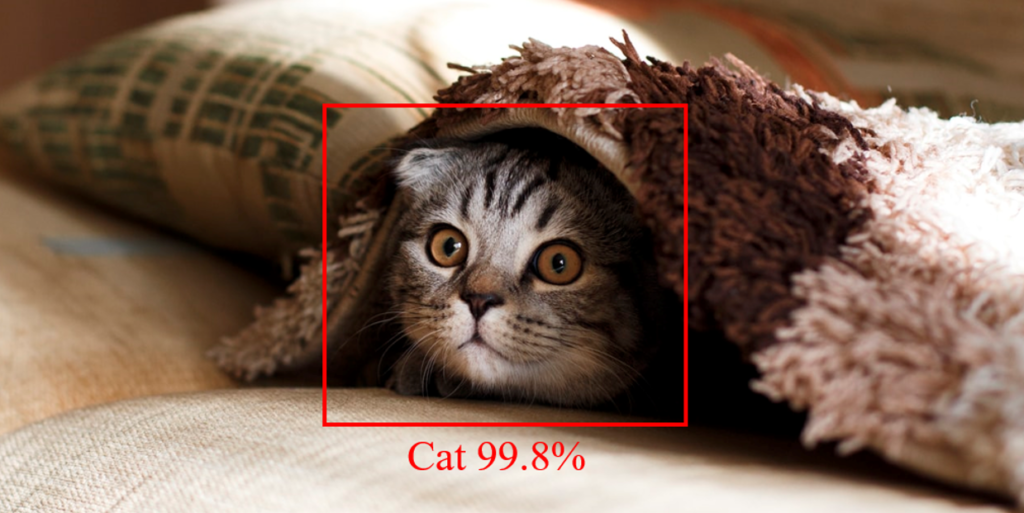

簡単な猫モデルを用いて説明すると、大量の猫の画像(Cat Data)があれば、猫を区別するための関数(重み)を、結果と入力層を行き来し、何度もフィードバックさせることで、逆算的に関数(重みw)を求めることが可能となる[図2]。これにより精度が高まったモデルを使用することで、猫を見分けるアルゴリズムが完成する。

※AI面接では、言語処理で使用されるRNN(Recurrent Neural Network )も用いられているが、今回は省略する。

つまり猫が猫であることを認識させるためには、大量の”お手本”となる「教師データ」が必要となる。この「教師データ」によってはアルゴリズムそのものに偏りを生じることになる。

では今後、普及するであろうAIによる人材マネジメントの「教師データ」として、どこを参照するのか?

2.AIの抱える問題

AIを用いて人材マネジメントを行う上で、人間の裁量基準に近づける教師データを集めた場合、現代の社会構造をコピーした判断基準になる可能性が高い。つまり学歴や性別、体格などの様々なデータによりバイアスが掛かった階層社会が出来上がる。高学歴者がシェアを占める企業であれば高学歴者が選ばれ、日本人の企業であれば民族間バイアスが既に存在している状態がアルゴリズムにも反映される。

実は、この問題については最近のApple card(クレジット)で炎上してニュースになっている。8月に開始されたクレジットカードだが、AIによるクレジット審査で女性より男性の利用限度額が高く設定されていたのだ。結果的に性差別とされて炎上した。当たり前だがAIが性差別を意図した訳でなく、教師データが女性より男性側の所得で明らかな有意差を持っていたために起きたと、容易に想像できる。

このように明確に社会問題化するようなバイアスであれば、パラメータを調整することでアルゴリズムを変更可能である。問題なのは、AIを開発・管理する組織が現時点では世界有数の大企業であることだ。社会問題化しないバイアスは、マイノリティー(少数派)として除外され、大企業にとって不利なデータも見過ごされる危険性がある。